사전 지식 - Cross-attention Control

https://wzacorn.tistory.com/116

Prompt-to-Prompt Image Editing with Cross Attetion Control 리뷰

0. Abstract대규모 텍스트 기반 이미지 합성 모델의 발전관련 기술에 대한 수요로 주목받고 있으나, 텍스트 프롬프트의 작은 변화에도 결과가 크게 달라지는 문제 발생기존 이미지 편집 방법의 한

wzacorn.tistory.com

이전에 관련해서 리뷰해둔 내용이 있으니 참고하면 좋을 것 같다.

Inpainting 기법(지정한 영역의 이미지의 일부만을 생성)은 기존 attention map 정보가 없다는 단점을 보완하는 방식.

prompt to prompt로 제어할 수 있는 강력한 장점 존재.

- pixel 과 text사이의 상관관계를 나타내는 attention map. pixel은 설명하는 단어에 더 attention 됨.

- bird와 bear의 attetion map을 겹쳐 같은 공간의 이미지만을 변환 시키는 방법이 cross attetion map control

Abstract

Custom Diffusion은 텍스트-이미지 확산 모델에 개인화된 컨셉을 효율적으로 통합하고, 기존 방법의 한계를 극복하기 위해 여러 가지 혁신적인 기여를 제시. 주요 기여 내용은 다음과 같다.

- 사용자가 제공한 몇 장의 이미지만으로 새로운 컨셉(예: 개인의 애완견, "moongate" 등)을 텍스트-이미지 확산 모델에 빠르게 통합 가능.

- 메모리 및 계산 효율성예시: A100 GPU 2개에서 약 6분 이내에 fine-tuning 가능

- 모델의 전체 파라미터 중 약 3%에 해당하는, 크로스 어텐션 레이어의 키(key) 및 값(value) 매핑과 관련된 가중치만 업데이트하여 fine-tuning 시간을 단축하고 메모리 요구 사항을 크게 줄임.

- 단일 컨셉을 fine-tuning하는 것을 넘어, 여러 새로운 컨셉을 동시에 합성

- 애완견이 moongate 앞에 있는 모습"과 같이 복합적인 컨셉 조합을 통해 새로운 이미지를 생성

contribution & Method

수식 1은 확산 모델이 초기 노이즈 이미지에서 시작하여 점진적으로 노이즈를 제거하면서 최종 이미지를 생성하는 전체 과정을 수학적으로 표현한 것

- pθ(x0): 모델(θ)이 생성하는 이미지 x0의 분포를 나타냄. 즉, 모델이 최종적으로 만들어내는 이미지들이 어떤 특징을 가지는지 설명하는 함수

- ∫ dx1:T: x1부터 xT까지의 모든 가능한 경로에 대해 적분을 수행한다는 의미.

- x1 부터 xT: 확산 과정을 거쳐 생성된 latent 변수를 나타냄. 즉, 이미지에 노이즈를 점진적으로 추가하는 과정을 timestep 별로 표현한 것.

- 이 적분은 가능한 모든 latent 변수들의 영향을 고려하여 최종 이미지 분포를 계산하는 것을 의미.

- pθ(xT): T 시점에서의 이미지 분포.

- T 시점은 노이즈가 최대로 섞인 상태를 의미하며, 이때의 이미지 분포는 가우시안 분포를 따르는 것으로 가정

- ∏ ptθ(xt−1|xt): xt에서 xt-1로 변환될 확률을 모든 time step에 걸쳐 곱한 값임. 즉, 노이즈가 섞인 이미지 xt에서 노이즈를 제거하여 이전 단계의 이미지 xt-1을 생성하는 확률을 나타냄.

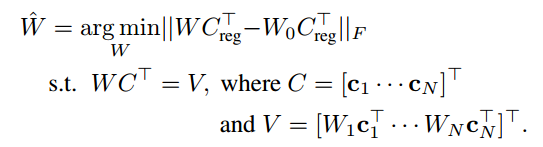

이 논문의 핵심인 수식2는 여러 개념을 합성하기 위해 기존 모델의 파라미터를 최대한 유지하면서 각 개념의 특징을 정확히 반영하도록 최적화된 파라미터를 찾기 위함.

- Wˆ: (W-hat): 우리가 최종적으로 찾고자 하는 업데이트된 파라미터 즉, 여러 개념을 합성할 수 있도록 조정된 모델의 핵심 요소.

- argminW ||WC⊤reg − W0C⊤reg||F: "W에 대해 최소화한다"는 의미. 즉, 정규화된 텍스트 특징(Creg)을 사용하여 업데이트된 파라미터(W)가 사전 훈련된 모델(W0)에서 크게 벗어나지 않도록 하면서, Frobenius norm (|| ||F)을 사용하여 차이를 최소화하는 W를 찾는 과정.

- WC⊤reg: 업데이트된 파라미터 W를 사용하여 정규화 텍스트 특징 Creg를 매핑한 결과.

- W0C⊤reg: 사전 훈련된 모델의 파라미터 W0을 사용하여 정규화 텍스트 특징 Creg를 매핑한 결과.

- ||WC⊤reg − W0C⊤reg||F: 업데이트된 모델과 사전 훈련된 모델의 출력 차이를 최소화하는 것을 목표로 함. 이는 모델이 기존 지식을 잊지 않도록 하는 역할을 포함.

- s.t. WC⊤ = V: "subject to"의 약자로, 제약 조건을 의미. 즉, 업데이트된 파라미터 W는 특정 제약 조건을 만족.

- WC⊤: 업데이트된 파라미터 W를 사용하여 타겟 텍스트 특징(C)을 매핑한 결과.

- V: 각 개념에 대해 fine-tuning된 모델이 타겟 텍스트 특징(C)을 매핑한 결과를 모아놓은 것.

- WC⊤ = V: 업데이트된 파라미터 W는 타겟 텍스트 특징(C)을 V와 최대한 가깝게 매핑해야 한다는 제약 조건. 이는 합성하려는 각 개념의 특징을 정확하게 반영하도록 하는 역할.

- C = [c1 · · · cN ]⊤: N개의 개념에 대한 텍스트 특징을 모아놓은 행렬. 각 ci는 i번째 개념에 대한 텍스트 설명(caption)을 벡터로 표현.

- V = [W1c⊤1 · · · WNc⊤N ]⊤: 각 개념에 대해 fine-tuning된 모델(W1, ..., WN)이 각 개념의 텍스트 특징(c1, ..., cN)을 매핑한 결과를 모아놓은 행렬.

result

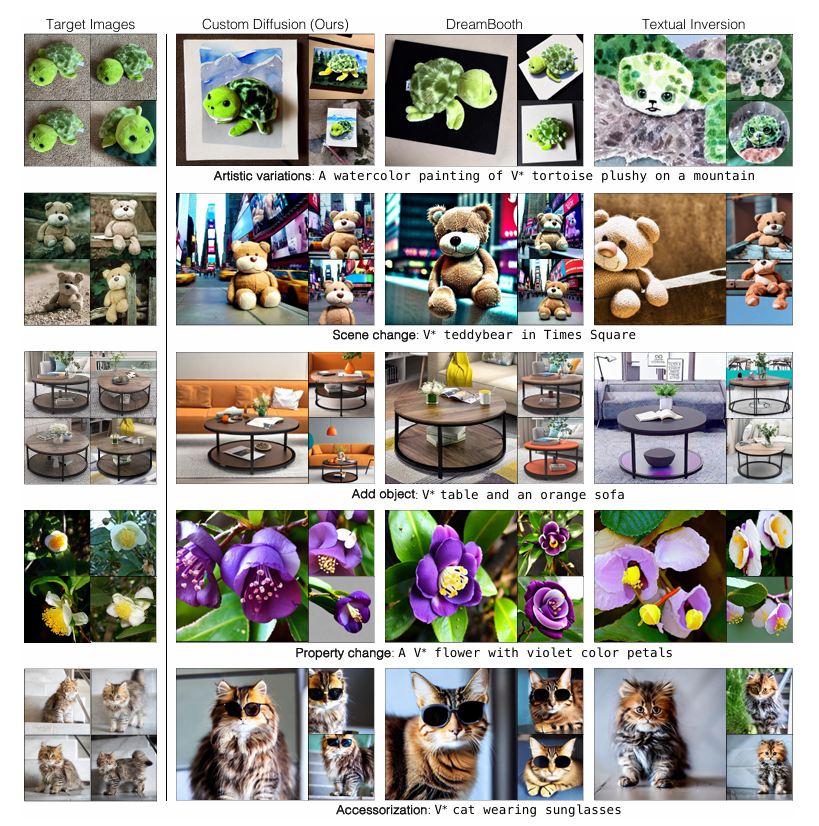

단일 컨셉 fine-tuning 결과

- 모델이 특정 컨셉(예: 곰인형, 고양이, 꽃 등)을 다양한 장면, 예술 스타일, 액세서리, 객체 추가, 속성 변경 등의 프롬프트로 성공적으로 생성함.

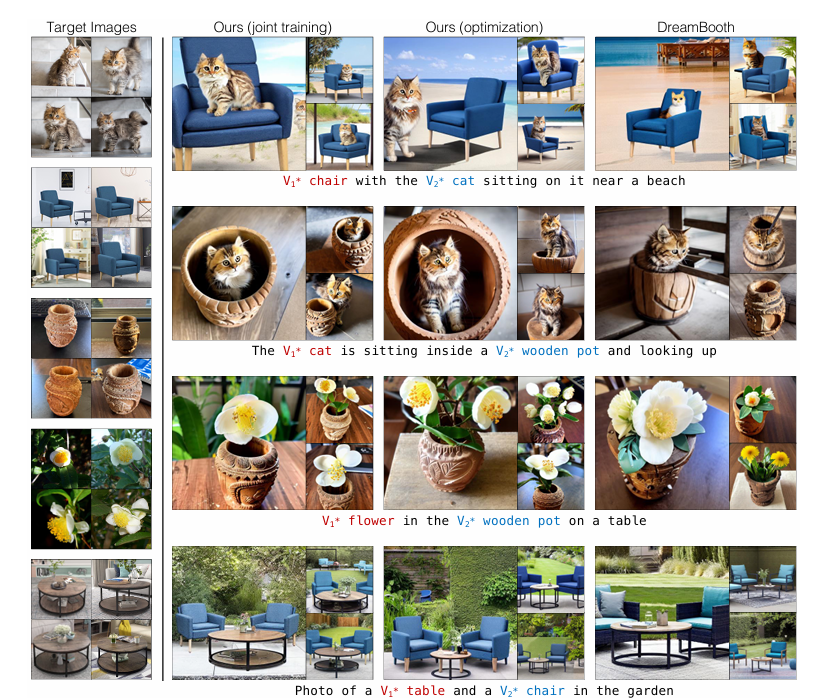

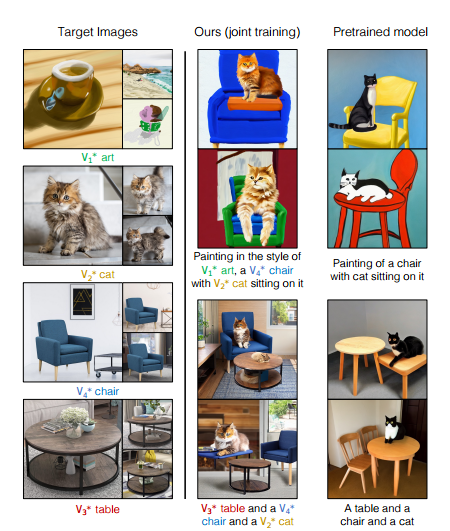

다중 컨셉 fine-tuning 결과

- 한 장면에 두 개 이상의 새로운 컨셉(예: "Moongate + Dog", "Cat + Chair")을 일관성 있게 생성함

- DreamBooth가 여러 컨셉 생성에 어려움을 겪는 반면, Custom Diffusion은 텍스트 프롬프트와 높은 일관성을 유지하며 성공적으로 두 객체를 생성함

Limitation

이 논문에서는 다음과 같은 한계점을 지적함.

- 개념 수 증가의 한계: 세 개 이상의 개념을 함께 합성하는 것은 여전히 어려움.

- Textual Inversion의 한계: Textual Inversion은 두 개의 fine-tuning된 객체를 합성하는 데 어려움이 있습니다

- 이미지-텍스트 정렬의 trade-off: 목표 이미지와의 높은 유사성을 얻으면 새로운 프롬프트에서 텍스트 정렬이 저하될 수 있음

- 학습 프롬프트에 대한 과적합: fine-tuning 동안, 목표 이미지는 텍스트 프롬프트인 "photo of a V* {category}"와 함께 학습되므로, 텍스트 프롬프트 "photo of a {category}"에 대한 생성이 목표 이미지 쪽으로 치우칠 수 있음.

- 생성된 이미지를 정규화 데이터로 사용할 때 문제: V* dog에 대해 fine-tuning된 모델은 "a dog" 프롬프트에 대해 채도 artifact가 있는 이미지를 생성할 수 있음. 높은 학습률을 사용하면 이러한 문제가 발생할 수 있음.

요약하자면, Custom Diffusion은 Stable Diffusion 1.4 모델의 사전 훈련된 모델의 한계를 상속받음. 또한 복잡한 조합이나 여러 개념을 합성하는 데 어려움이 있으며, 또한, 이미지-텍스트 정렬 간의 trade-off, 학습 프롬프트에 대한 과적합, 정규화 데이터 생성 방법 등에서 추가적인 개선이 필요함.

'paper review' 카테고리의 다른 글

| Multi-Concept Customization of Text-to-Image Diffusion 실습 (0) | 2025.03.19 |

|---|---|

| DREAMBENCH++: A Human-Aligned Benchmark for Personalized Image Generation 리뷰 (0) | 2025.03.18 |

| Prompt-to-Prompt Image Editing with Cross Attetion Control 리뷰 (0) | 2025.02.24 |

| The Chosen One: Consistent Characters in Text-to-Image Diffusion Models 리뷰 (0) | 2025.02.18 |

| HyperClova X Technical Report (0) | 2024.04.11 |